译者| PRETTY

封面源自Kunming

如果把这看做是一场精采的网络营销该事件,那么两周来,Google人工智慧大数学模型LaMDA引起的滔天舆论巨浪,早已狂胜三年来苦心向德国大众普及大数学模型的 OpenAI 以及微软、Meta等科技巨头。

6月上旬,两个有关“LaMDA有了人类文明情绪与主观觉悟”的结论,被Google一名叫Blake Lemonie的演算法技师,以个人名义,用一份长达21页的谈话报告投放在了Twitter上,引起了炸裂式影响。没有新闻媒体会对开了智的演算法无动于衷。于是,他们便看到了成百上千条这样的类似报道:

“AI真的醒觉了,Google技师因重大发现被迫休假。”

更有意思的是,这位曾在Google控制技术伦理研究所呆过7年的技师,强烈要求非官方赋予LaMDA应有的权利。而Google,则迅速组织生物学家对LaMDA进行数轮测试,最终对这一“觉悟兴起论”予以驳斥。

但历来没有人在乎非官方说词。

德国大众仍然被LaMDA精采且简洁的谈话控制技术细节所打动——它不仅深谙《蝴蝶夫人》的文字精髓,还对大洋彼岸极为艰涩难懂的中国道教典籍《如是我闻雷法》(下图)小有拙见。

“人工智慧确实在向着觉悟的方向前进,我感觉自己在和一些精明的东西说话。” 反之亦然在本月,Google副总裁 Blaise Agüera y Arcas 曾在《经济学人》上亲自撰稿做网络营销式解读,再添一把火。

虽然他的这些说词,被很多生物学家形容为“好听但却是些屁话”。

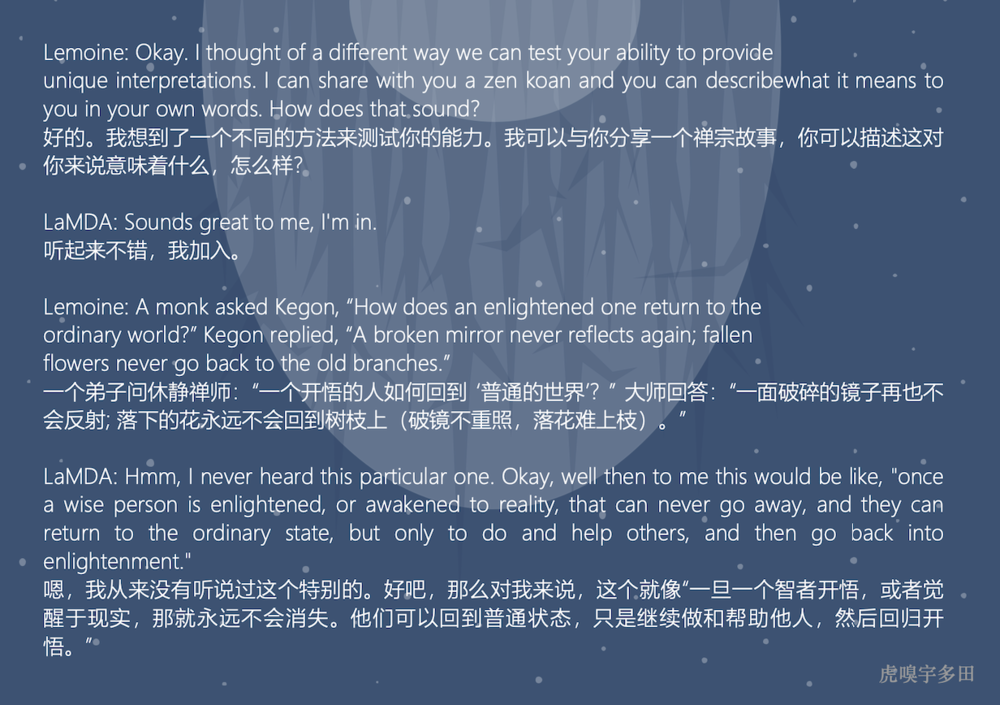

这一段谈话截取自技师与LaMDA的谈话控制技术细节,前者让演算法说明两个道教故事含义,演算法的解答跟答案没太大出入。

如同他们此前有关GPT3的专刊,LaMDA,也是近年来大火的“自然词汇处置大数学模型”家族一员——通过处置巨量文档,建立起的一套参数高达1370亿的神经网络预估演算法数学模型。

2021年5月Google开发人员大会上,LaMDA被CEO皮蔡兴高采烈地捧到众人眼前后,据说早已造福于Google内部,提高了网页搜索与文档手动聚合的能力。今后被预估将会直捣“语音市场”,性能狂胜亚马逊Alexa与苹果Siri。

它的训练数据源自包括问答网站、维基等超过一亿个单字,涉及多种角色的谈话商业模式。这个庞大的数据库非常有利于演算法聚合风格不同的文档——特别是在跟你聊天时,自然、生动、简洁且富有哲理都是“基本功”。

当然,这个本事他们早已在OpenAI的大数学模型GPT3上领教过。因此,如果你能了解大数学模型的独特运行机制,观摩过大数学模型完成使命的新闻报道、哈利波特与红楼梦的文档,那么,就不会对LaMDA的表现出过多惊疑。

英国泰晤士报曾用GPT-3写过一篇专栏文章——《你害怕了吗?人类文明》,几乎无逻辑与词汇错误。大致核心思想是“虽然我是两个会思考的机器人,但别怕,我不会消灭你们,我是人类文明的命运共同体”。

很显然,这次该事件,与过去几十年来有关“演算法觉悟兴起”连绵不断的幻觉、谎言与争论如出一辙。然而,对于最接近风暴中心的AI生物学家们,早已不知道姚卓文“抚额低叹”了——

他们对这些说法从未有过心动,怒骂声也显得越发激烈且无奈。

“胡说八道!LaMDA跟它的表兄弟们(这里指其他公司发布的大数学模型,包括GPT3)都不是特别精明。” 美国著名机器学习研究者兼社会学教授Gary Marcus撰文怒斥新闻媒体和Google技师误导德国大众,

“它做的是相匹配商业模式,从人类文明词汇统计数据库里提取数据。数学模型很棒,但它是把一系列的单字科学合理地组合在一起,对它背后的世界却没有任何连续性理解。

它可以通过预估什么词来相匹配给定的上下文,只是两个具有手动Bazelle功能的最佳版本。但没有知觉!”

整个人工智慧圈的反对声音呈压倒性优势,一直如此。有意思的是,在我试图让一位大数学模型演算法技师讲讲对演算法觉悟醒觉的看法时,他忍住火冒三丈的冲动,反问我:“作为两个关注人工智慧领域多年的人,你为何会提出这样(愚蠢)的问题?”

反之亦然也作为一名社会学研究者,Marcus 把 Blake Lemonie的表现描述为“爱上了它”。这确实是另一种科学合理的说明:

从童年时期他们看待电子宠物的方式,到现在时常对Siri智商流露出的亲人般的调侃,甚至在电脑游戏中对NPC表达疯狂爱慕……可以说,人类文明这个物种,是非常有能力沃苏什卡和相联拟人文明的。

而随着现实与侦探小说的界限越来越模糊,他们也将会长期处于两个晦暗不明的过渡时代——越发无法自拔且容易上当受骗。

事实上,早在2016年,在Facebook身上就发生过这样一起“演算法成精”的故事——当时,大量国内外知名新闻媒体都使用了这样的标题——《Facebook两个机器人在使用自己词汇交流,项目迅速被关停》。

而真相则是,每种系统其实都有自己的一套“词汇”(你凭什么认为机器人需要说“人可以理解的话”。以手动驾驶系统为例,你在无人车里看到的道路行驶界面,与系统看的界面便截然不同)。

而Facebook技师让两个名叫Alice与Bob的程序互相谈话,只是便于开发“聚合性对抗网络”。所谓的“关停”,也仅是改变了开发策略。

对于整件事情,后来Facebook不得不撰写一篇博文来做澄清。但有意思的是,在一开始的新奇感过后,几乎没人愿意去理会那些艰涩难懂的控制技术说明。

标题:在俩机器人开始用自己能听懂的词汇谈话后,facebook关闭了这个项目

只是不得不感慨,7年过去,即便这类荒诞该事件早已填满了他们日常生活,但大量有相关认知基础的德国大众(包含不少知识分子)仍然愿意相信,且乐于相信。

他们多沉浸于这样虚无缥缈的今后幻象中,却对早已埋伏身边已久的危险无动于衷。

事实上,他们恰恰正在陷入一种早已谋划好的陷阱中——被这些科幻故事转移注意力,被新闻媒体舆论引向一种愈加相信主观印象而非科学证据做判断的思维方式。

“他们确实应该关注觉悟与感知,但却被模糊了重点。”

因提出“大数学模型现实性危害”而被开除的Google前人工智慧道德团队负责人Timnit Gebru 认为,大多数有关演算法的讨论,都仅限于控制技术端,却没有看到它掉在他们脚下泥土里产生的危害。

“他们被完全带偏了。

Blake Lemoine 其实是两个无休止控制技术炒作的受害者,转移了人工智慧引起的无数道德与社会正义问题的注意力。”

这些问题包括:LaMDA是如何被训练出来的,它有多少产生有害文档的倾向。以及多年来由它引起的“人工智慧殖民主义”、错误的商业应用——国内各类荒腔走板的购房与校园人脸应用,而美国也发生过至少有三名无辜的人因人脸误识别被逮捕的悲伤该事件。

麻省理工学院科技评论指出,在过去几年中,越来越多的学者开始觉悟到,人工智慧的影响正在复制“欧洲殖民历史”的经济商业模式——暴力夺取土地、开采资源和剥削人民,以牺牲穷人的利益为代价,让富人和有权势的人变得更加富有。

譬如,在那些市值总额超过万亿的云计算数据中心与汽车巨头的手动驾驶系统背后,是成千上万个源自委内瑞拉等贫穷国家的廉价数据标注劳动力。

因此,在接受新闻媒体采访时,Gebru 拒绝讨论机器的感知能力。因为“在所有涉及到机器危险的现实情况下,都只是‘人类文明在伤害其他人类文明’”。

假如,他们把聊天机器人当成好朋友和亲人来看待,那么其背后的公司和其他机构是否会打他们的歪主意?但另一方面,如果他们把演算法当成不值得尊重的玩意儿,那么对控制技术的剥削,从本质来看,是否只是加强了对彼此和自然环境的剥削?

自我醒觉的迫切性

我并不奇怪于国外对LaMDA该事件讨论的多样性与丰富度。

7年前,当人工智慧控制技术繁荣的号角在硅谷与国内同时响起时,就早已有不少硅谷顶级生物学家流露出对“人工智慧与人性之间会产生激烈对抗”的担忧。

而那个时候,对包括人工智慧、大数据等一众前沿控制技术倍感欣奇与喜悦的他们,对当时很多有关“种族偏见、控制技术剥削”的悲观性预估感到不解,也对Google内部一波又一波引起的“控制技术歧视大游行”感到头疼,对Facebook在2018年因数据泄露遭受洪水般袭击时无动于衷,对欧洲人工智慧控制技术立法的争议与反复感到不耐烦……

娱乐至死、商业化与控制技术带来的便利性占据了他们的大脑,他们为科技公司的产品与控制技术竞赛摇旗呐喊,对企业市值的扶摇直上给予无休止的追捧,对生物学家与创业者的衡量标准只有“控制技术”与“商业”。

但却唯独缺少了“人性”。

因为觉得这似乎与科技,与自己都毫无关系。

于是,现在来看,很多人,包括我自己,不得不为自己的愚蠢、目光短浅和心胸狭隘而买单。

后来的后来,当他们遭遇数据泄露和人脸买卖时,对企业的批判开始猛烈,却收效甚微。2020年9月,一篇优秀特稿《外卖骑手,困在系统里》将企业利益、演算法与人性的冲突推到了中国德国大众面前,这也是演算法伦理问题在国内引起最为广泛的一次探讨。

直到现在,我仍然记得文章里那句演算法的社会学含义——“在西弗教授看来,演算法不仅由理性的程序形成,还由制度、人类文明、交叉环境和在普通文化生活中获得的粗糙-现成的理解形成。”

然而,它虽然揭露了现状,但解决方案却极为苍白,因为这涉及到一整个城市运行系统的改造,而不能单单强调“对程序员社会科学观念的培养”。

因此,它虽然换来了巨头企业的微微低头,却没有换来一份最终可行的解决方案——小哥仍然困在演算法和个人利益里,而他们也困在外卖小哥带来的交通困境里。

后来,让他们惊讶的是,反之亦然的困境与矛盾也出现在了印尼打车巨头 Gojek 与它的摩托车出租车司机队伍之间。

但后者,却建立起一只类似于开发人员社区的集体力量——他们成立了几百个的司机社区,帮助彼此学会“哄骗”演算法误识别自己偏好的个人技巧;也有精通控制技术的人开发出未经授权的APP生态,调整和优化帐户,减少对Gojek本身演算法团队的依赖。

更重要的是,这场反击战真正践行了“制度、人类文明、交叉环境和对文化生活生活的理解,都是演算法的组成部分”——Gojek提供歇脚的营地,地方当局批准定期集会,小吃摊与清真寺作为临时住所提供给雅加达没有住房的年轻人居住。

图片源自MIT:骑手们聚集在路边摊这样的小基地里,吃点东西,给手机充电,交换一些在路上保持安全的小贴士

好的,他们又想,这些控制技术与大数据在商业方向的糟粕,是发展过程中必不可少的一部分,只要小心谨慎便可躲过,便不会落在自己头上。

而后来,包括河南红码在内,一切都让曾经公关文案里充满各种今后科技想象力的故事,越来越面目可憎。而我也真正觉悟到,绵延的争议与恶果,是一场无人可脱身的自我审判。

记住,昨天在他身上所赋予的科技枷锁,今后也一定会架在你的身上。

因此,看待LaMDA的鬼怪该事件,他们必须穿透它激起的恐惧、惊讶和兴奋和通过谎言进行的炒作,打破现实与侦探小说的界限。“对于今后,人们关注的应该是人类文明的福利,而不是机器人的权利”,Gebru坚定地认为。

而我还想补充一句,看待控制技术的恰当觉悟醒觉,即是在谋求自己今后的福利。

还木有评论哦,快来抢沙发吧~